KI im Finanzsystem: Kann Risiken und Nebenwirkungen aufweisen

(17.11.2025)Die rasante Entwicklung der künstlichen Intelligenz (KI) macht auch vor dem Finanzsystem nicht halt. Und sie wird es verändern – darüber besteht kein Zweifel. Welche Risiken birgt die KI speziell für Banken und für die Finanzmarktstabilität? Wo liegen die Gefahren für die Kunden? Und wie können wir diese Herausforderung meistern? Ein Vergleich von fünf internationalen Studien gibt Antwort auf diese Fragen.

Der Finanzsektor ist besonders gut für den Einsatz von KI geeignet. Weil er digitalisierbaren Output produziert und sich auf Datenverarbeitung und spezialisiertes Humankapital stützt. Von Betrugserkennung und Coding bis hin zu Kundenberatung und Veranlagung ergeben sich bei Banken, Versicherungen und Fonds viele Anwendungsmöglichkeiten für die KI.

Aber der Finanzsektor wird nicht nur als Nutzer von KI betroffen sein. Die KI wird auch in vielen anderen Wirtschaftsbereichen zu einem Strukturwandel führen. Dies wird sich auf die Kreditqualität der Schuldner (z. B. Unternehmen, Haushalte oder Staaten) auswirken. Besonders dann, wenn der Strukturwandel abrupt erfolgt. Zudem ist der Finanzsektor anfällig für Cyberangriffe, die durch die KI noch verstärkt werden können.

Neben den Chancen, die die KI verspricht, bringt sie auch Risiken mit sich – und diese sind oft schwer messbar. Vor allem die Komplexität und die Geschwindigkeit, mit der die KI an den Finanzmärkten Einzug hält, stellen die klassische Finanzmarktaufsicht und die Risikomessung vor Herausforderungen. Weltweit arbeiten Zentralbanken und Aufsichtsbehörden daher daran, den Wandel, den die KI mit sich bringt, zu bewerten. So auch der Internationale Währungsfonds (IWF), die Bank für Internationalen Zahlungsausgleich (BIZ), die Europäische Zentralbank (EZB), der Finanzstabilitätsrat (Financial Stability Board (FSB) und die britische Notenbank (Bank of England). Ein Vergleich aktueller Studien dieser fünf Institutionen zeigt: Ihre Erkenntnisse sind ähnlich, aber sie verwenden unterschiedliche Begriffe, was die Vergleichbarkeit erschwert. Folgende KI-Risiken werden am häufigsten genannt:

- Intransparenz: KI-Modelle, vor allem große neuronale Netze, sind oft Black Boxes. KI-gestützte Kredit- und Risikomodelle sind nicht nur intern schwer nachvollziehbar, sondern auch für externe Aufseher schwierig zu kontrollieren.

- Herdenverhalten: Setzen viele Marktteilnehmer bei ihren Veranlagungs- oder Kreditentscheidungen auf das gleiche KI-Modell, könnte dies zu einem Herdenverhalten führen. Damit ergeben sich künstlich synchronisierte Kaufs- und Verkaufsperioden, die im Extremfall systemische Blasen oder Crashs zur Folge haben können.

- Cyberrisiken: Die KI gibt nicht nur Cyber-Angreifer:innen ein neues Werkzeug, um Schadsoftware besser und schneller zu programmieren. Sie bietet auch selbst eine neue Angriffsfläche, z. B. wenn Banken einen Chatbot zur Kundenbetreuung verwenden („Jailbreaks“). Auch Kunden können direkt betroffen sein: Die schon bekannten Phishing-Attacken können mithilfe von KI zu „Spear-Phishing“ ausgebaut werden. Dabei wird der Köder (z. B. ein Phishing-Mail) haargenau auf das Opfer zugeschnitten und mit vielen persönlichen Details desselben (z. B. aus sozialen Netzwerken) angereichert, sodass Betroffene seltener Verdacht schöpfen.

- Konzentration im Technologiesektor: Die Abhängigkeit von wenigen Technologie-Anbietern, z. B. im Cloud- oder Chip-Bereich, erhöht Kosten und Klumpenrisiken, etwa wenn deren Ausfälle in einer Krise zur Belastung für das ganze System werden. Zwar gibt es derzeit viele KI-Anbieter und -Entwickler, doch ist der Markt für entsprechende Hardware, vor allem Grafikprozessoren (GPUs), derzeit als monopolistisch anzusehen.

Indirekte Effekte werden unterschätzt

Bemerkenswert ist, dass die meisten der hier untersuchten Studien die indirekten Effekte der KI-Veränderungen – also ihre Wirkung auf Schuldner, andere Wirtschaftssektoren und die makroökonomische Stabilität – weitgehend ausblenden. So drohen zum Beispiel Kreditausfälle, wenn durch KI-bedingte Produktivitätssprünge herkömmliche Geschäftsmodelle wertlos und Branchen umgewälzt werden. Auch die Gefahr einer „KI-Bubble“ – also enttäuschte Erwartungen, wenn KI-Investitionen keine ausreichenden Erträge abwerfen – wird in den untersuchten Studien nicht diskutiert.

Keine gemeinsame Terminologie oder Klassifikation

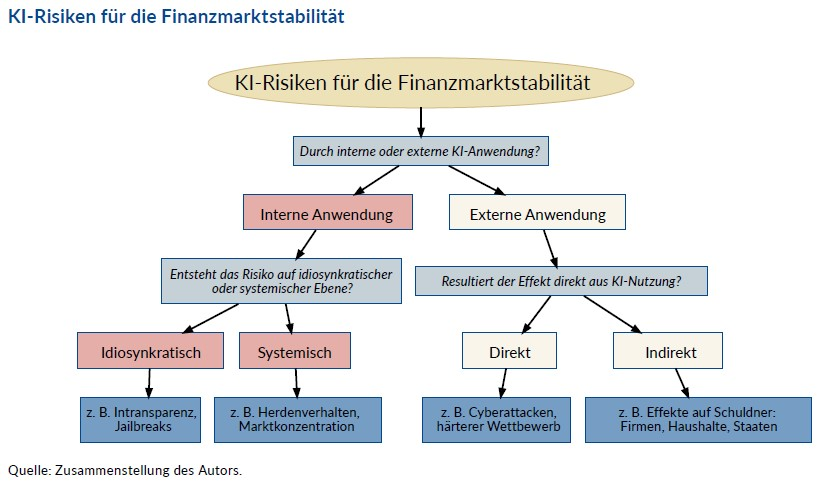

Ein Vergleich der Studien zeigt auch, dass es noch keine gemeinsame Terminologie oder Klassifizierung von KI-Risiken gibt. Das nachstehende Schaubild versucht, die vielen KI-Risiken im Finanzsektor systematisch darzustellen. Dabei wird zuerst unterschieden, ob ein Risiko durch eine KI-Anwendung innerhalb oder außerhalb des Finanzsektors entsteht. Bei internen KI-Anwendungen wird unterschieden zwischen Risiken, die nur im systemischen Kontext entstehen, also in Zusammenschau mit den Handlungen anderer Marktteilnehmer (wie Marktkonzentration oder Herdenverhalten), und Risiken, die auch bei isolierter Betrachtung entstehen können, also ohne die Handlungen anderer Marktteilnehmer in Betracht zu ziehen (wie Intransparenz und Cyberrisiken). Bei externen KI-Anwendungen wiederum lässt sich unterscheiden zwischen solchen, die sich direkt auf die Finanzmarktstabilität auswirken, und solchen, die sich indirekt auswirken.

Vier Szenarien für die KI-Zukunft des Finanzsektors

Gerade Ökonom:innen sind über die weitere Entwicklung der KI sehr unterschiedlicher Meinung. Bisherige Überlegungen lassen sich in vier Szenarien zusammenfassen, die unterschiedliche Geschwindigkeiten bei der Entwicklung von KI unterstellen. Entsprechend lassen sich auch die wesentlichen Herausforderungen darstellen.

- Moderater KI-Fortschritt: In diesem Szenario sind Deep Fakes ein zentrales Problem – noch dazu, weil sie bereits mit herkömmlichen Technologien überzeugend echt wirken können. Mit „Informationsbomben“ können Betrüger:innen z. B. versuchen, Märkte zu manipulieren, etwa um von extremen Kursauschlägen zu profitieren. Um Deep Fakes rasch entgegentreten zu können, müssen die Finanzmarktteilnehmer über solide Eigenkapital- und Liquiditätsreserven verfügen, muss die Aufsicht glaubwürdig sein, die Kunden entsprechend informiert und gegenüber Betrugsversuchen skeptisch.

- Disruptiver Produktivitätssprung: Wohlstand beruht auf Produktivitätssteigerungen. Kommt es aber zu sprunghaften technologischen Änderungen, auf die sich die Gesellschaft nicht rasch genug einstellen kann, kann das einen disruptiven Strukturwandel zur Folge haben. So hat die Erfindung der Dampfmaschine oder der Elektrizität langfristig unseren Wohlstand enorm gesteigert, aber kurzfristig auch einigen Unternehmen ihre Geschäftsgrundlage geraubt und damit Menschen ihre Beschäftigung. Je plötzlicher eine neue Technologie eine alte ersetzt und je weniger eine Gesellschaft die neue Technologie selbst als Chance nutzt, desto stärker werden Banken mit Kreditausfällen und die Regierungen mit sinkenden Steuereinnahmen und steigenden Sozialausgaben rechnen müssen. Hier gilt es, einen Ausgleich zu finden: Vorschriften zur KI-Sicherheit sind sinnvoll – ist die Regulierung aber zu streng, kann sie den Zugang zu KI und deren Nutzung einschränken. Das kann die Anpassung an die neue Technologie erschweren, die Wettbewerbsfähigkeit verringern und dadurch die Finanzmarktstabilität gefährden.

- Durchbruch zu künstlicher allgemeiner Intelligenz/Superintelligenz (AGI/SI): Sollte KI tatsächlich innerhalb eines Jahrzehnts den Menschen bei den meisten kognitiven Aufgaben übertreffen, so greifen auch die klassischen Instrumente der Finanzmarktstabilisierung nicht mehr wie gewohnt. In den Vordergrund rücken dann geopolitische Überlegungen und die Frage, wie wir sicherstellen können, dass KI menschliche Ziele ethisch verfolgt. Finanzmarktstabilitätsüberlegungen im engeren Sinne würden dadurch verdrängt. Um die Grundpfeiler der Finanzmarktstabilität aufrechtzuerhalten – also die Fähigkeit einer Gesellschaft, sicher und effizient zu sparen, zu investieren und sich Finanzmittel zu beschaffen –, müssen die Aufsichtsbehörden sehr flexibel sein, um mit den rasanten Veränderungen Schritt zu halten.

„KI Winter“: An den Aktienmärkten haben sich die hohen Erwartungen an das enorme Potenzial der KI in hohen Bewertungen von US-amerikanischen KI-Technologieunternehmen, Hardwareentwicklern und Energieproduzenten niedergeschlagen. Das Ausmaß der erwarteten Renditen birgt Potential für Enttäuschung auf volkswirtschaftlich relevantem Niveau. Die nachstehende Grafik zeigt die wachsende Bedeutung von Aktien im Finanzvermögen der US-Haushalte und den gewichtigen Anteil, den Big Techs an diesen Aktien haben. Würde das Kurs-Gewinn-Verhältnis von Microsoft, Meta, Google und Nvidia allein auf den langfristigen Durchschnitt des S&P500-Aktienindex sinken, wären 8 Billionen USD an Vermögen vernichtet. Damit würden Haushalte deutlich weniger konsumieren und ein internationaler Wirtschaftsabschwung wäre nicht auszuschließen.

Fazit: Das eine KI-Risiko gibt es nicht

Die KI wird vieles verändern, gerade im Finanzsektor. Neben den großen Chancen, die die KI mit sich bringt, gilt es vor allem die Risiken im Auge zu behalten. Dabei ist wichtig: Das eine KI-Risiko gibt es nicht. Vielmehr wirkt die KI als Katalysator für klassische Risiken (Kredit-, Markt-, Liquiditätsrisiken sowie operationelle Risiken), die sich potenziell systemisch verstärken. Damit die KI-Transformation in Europa gelingt, müssen die Marktteilnehmer besonders resilient, die regulatorischen Vorgaben technologieoffen und die Gesellschaft innovativ und wachsam sein.

Die zum Ausdruck gebrachten Ansichten müssen nicht zwingend mit den Ansichten der OeNB bzw. des Eurosystems übereinstimmen.